树(Tree)

具有正向剪枝的树算法。

输入

- 数据:输入数据集

- 预处理器:预处理方法

输出

- 学习器:决策树学习算法

- 模型:训练过的模型

功能

树(Tree) 是一种简单的算法,可通过类别纯度将数据拆分为节点。 它是随机森林(Random Forest)的前身。树(Tree) 可以处理离散数据集和连续数据集,可以用于分类和回归任务。

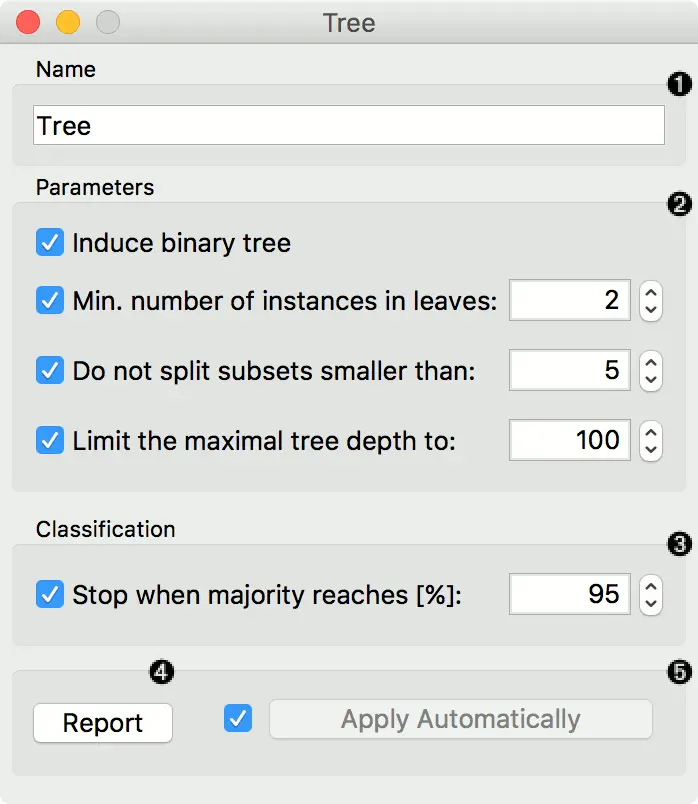

界面

- 可以给学习器一个名称,该名称将出现在其他小部件中。 默认名称是“树(Tree)”。

- 树参数:

归纳二叉树:构建一棵二叉树(分为两个子节点)叶中最小实例数:如果选中,拆分不会将少于指定数量的训练示例放入分支中。不要拆分小于以下值的子集:禁止算法分割少于给定实例数的节点。将树最大深度限制为:将分类树的深度限制为指定数量的节点级别。

-

当多数达到[%]时停止:在达到指定的多数阈值后停止拆分节点 - 发送报告

- 勾选 “自动应用” 以自动传送对其他小部件的更改,并在连接学习数据后立即训练分类器。 或者,在配置后按 “应用”。

示例

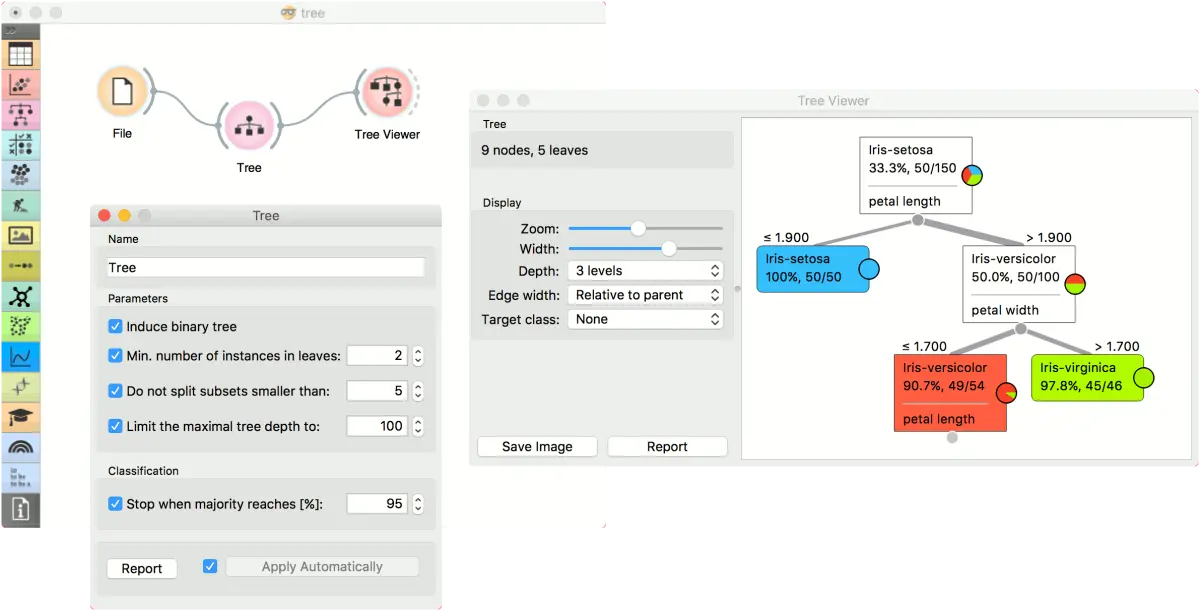

此小部件有两种典型用法。一个是您可能要引入一个模型并在查看树(Tree Viewer)中检查它。

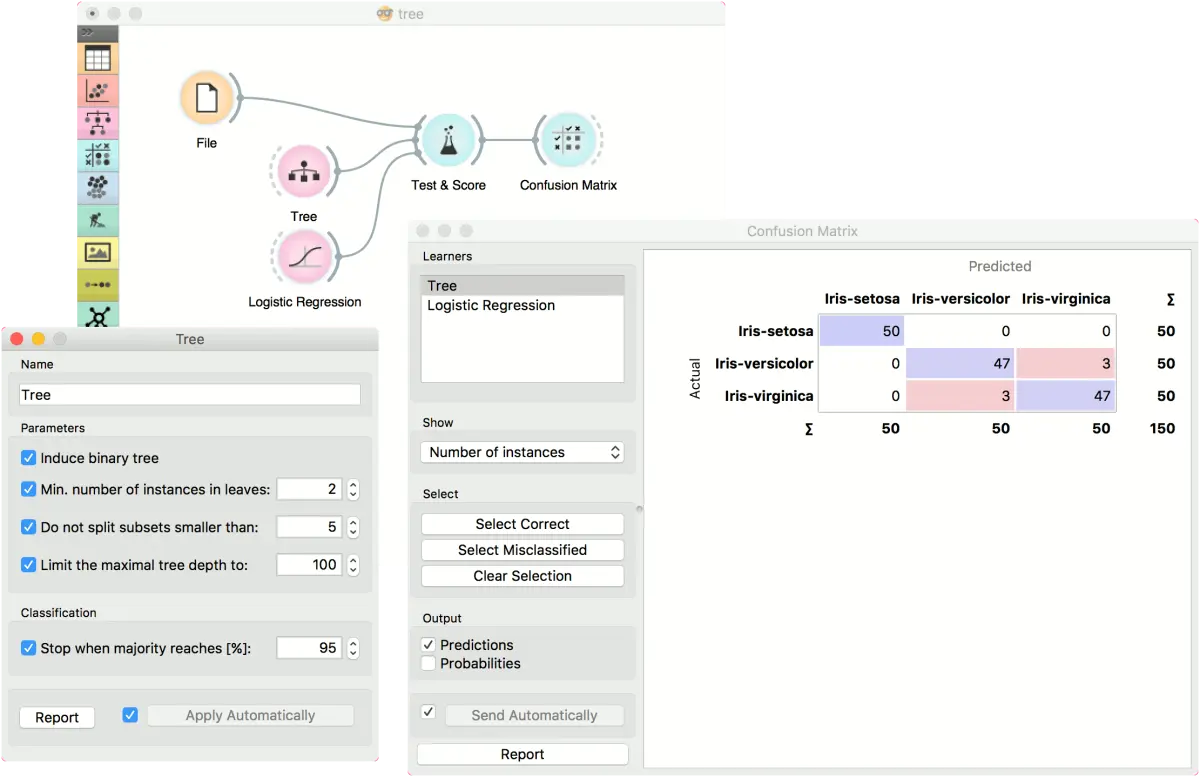

第二个是训练模型并比对逻辑回归(Logistic Regression)评估其性能。

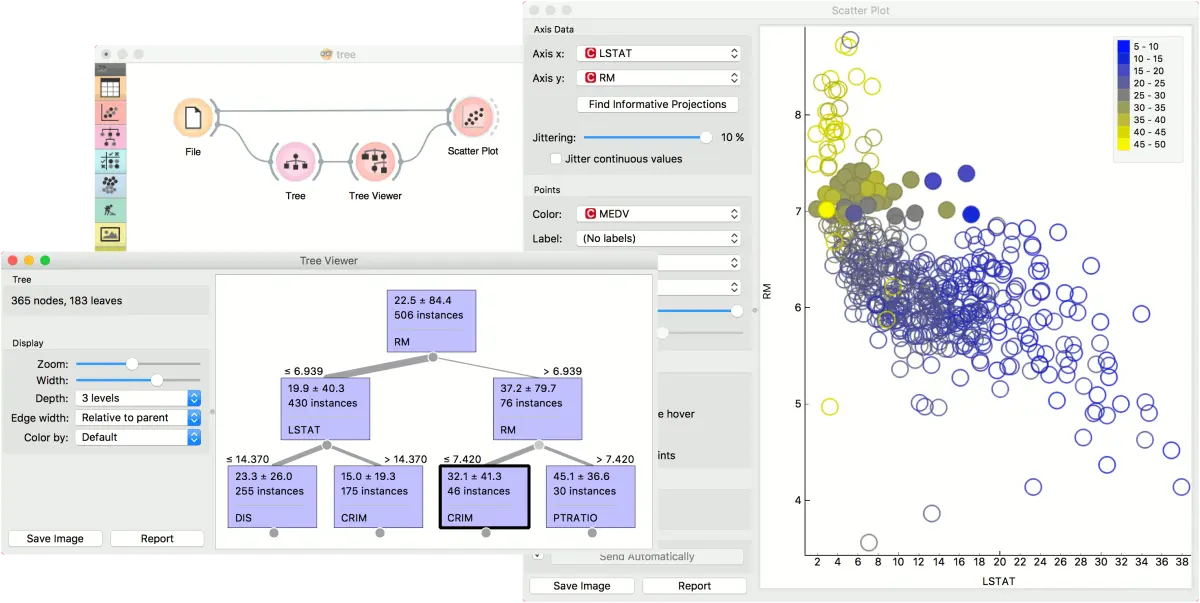

我们在两个示例中都使用了 iris 数据集。 但是,树(Tree) 也适用于回归任务。 使用 housing 数据集并将其传递给 树(Tree)。 从查看树(Tree Viewer)中选择的树节点显示在散点图(Scatter Plot)中,我们可以看到所选示例具有相同的特征。

反馈问题

文档有问题? 或者有其他意见和建议? 请在本文档的 Github 仓库直接反馈

点我反馈进入反馈页面不知道如何反馈, 请点击这里